2020 年度 10 篇人工智能经典论文

内容提要:2020 年即将过去,虽然这一年全球都笼罩在疫情的阴影之下,许多事情也因疫情而停摆。但是,人工智能领域依然逆势而上,取得了许多重大突破。在岁末之际,一起看看今年有哪些研究值得关注。

关键词:2020 AI 论文盘点,机器学习

2020 年已经接近尾声,这一年,尽管疫情对很多行业带来了不小的冲击,但科研工作者依然全心投入,仅在人工智能领域,我们就目睹了许多重大突破性的研究。

在今年的多场计算机领域顶级会议中,诞生了数千篇优秀论文。要逐一了解显然有点不切实际,不如挑选一些「必看论文」,比如这些由业内顶尖科技公司、专家学者一同精心挑选的,今年 AI 领域里十篇经典论文,覆盖自然语言处理、计算机视觉等方向。

这 10 篇 AI 领域经典论文分别是:

- 用于地震预警的分布式多传感器机器学习方法 A Distributed Multi-Sensor Machine Learning Approach to Earthquake Early Warning

- 通过高斯过程后验进行快速采样方法 Efficiently Sampling Functions from Gaussian Process Posteriors

- 迈向拟人化的开放域聊天机器人 Towards a Human-like Open-Domain Chatbot

- 语言模型是小样本学习者 Language Models are Few-Shot Learners

- 超越准确度标准:使用 CheckList 对 NLP 模型进行行为测试 Beyond Accuracy: Behavioral Testing of NLP models with CheckList

- EfficientDet:可扩展和高效的目标检测 EfficientDet: Scalable and Efficient Object Detection

- 从野外图像中对可能对称可变形的 3D 物体进行无监督学习 Unsupervised Learning of Probably Symmetric Deformable 3D Objects from Images in the Wild

- 用于大规模图像识别的转换器 An Image is Worth 16×16 Words: Transformers for Image Recognition at Scale

- AdaBelief 优化器:根据观察梯度的 Blief 调整步长 AdaBelief Optimizer: Adapting Stepsizes by the Belief in Observed Gradients

- ALBERT:语言表示自监督学习的轻量 BERT ALBERT: A Lite BERT for Self-supervised Learning of Language Representations

这十篇论文,几乎每一篇都获得了今年各大 AI 顶会的殊荣,亦或是在各自领域里取得了重大突破。

来看看有没有你还没来得及了解的论文?

1

论文地址:https://hal.archives-ouvertes.fr/hal-02373429v2/document

论文

《用于地震预警的分布式多传感器机器学习方法》

荣誉

获得 AAAI 2020 杰出论文奖

摘要

本项研究旨在通过机器学习提供地震预警系统(EEW)的准确性。此系统的设计核心目的为针对于中大型地震,在破坏性影响到达特定区域前探测出来。传统的 EEW 方法是基于地震检波器的,但由于传统方法对地震运动速度敏感性的问题,导致不能准确地识别大地震。而另一方面,由于引进的高精度 GPS 站点对其产生的噪音数据会有倾向性,也无法准确识别中等强度的地震。此外,全球定位系统站点和地震仪可能会在不同的地点进行大量部署,产生大量的数据,从而影响响应的时间以及 EEW 系统的稳定性。

在实践中,EEW 可以看作成机器学习领域中一个典型的分类问题:多传感器的数据为输入,地震的强烈程度为分类的输出结果。

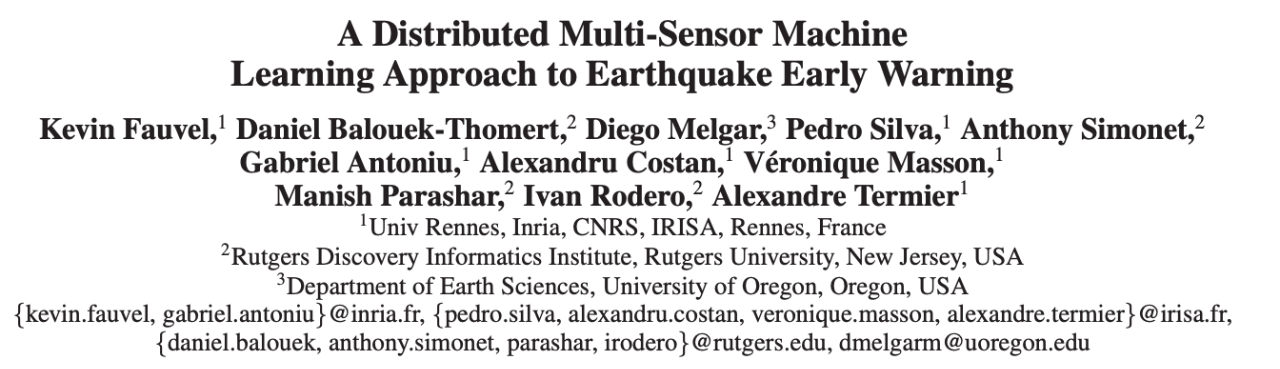

本文介绍了一种基于机器学习的分布式多传感器地震预警系统(DMSEEW),该系统结合了两种传感器(GPS 站台和地震仪)的数据进行探测。DMSEEW 是基于一种新的堆栈集成的方式,该方法已在实际的数据集中经过地理科学家们的验证。该系统是基于地理层面分布式的基础设施,以确保在响应时间和鲁棒程度下,即使有部分基础设施故障时依然保持高效计算性。实验结果表明,DMSEEW 方法与传统的地震预测方法和采用相对强度的组合传感器(GPS 和地震仪)方法相比,具有更高的精确度。

DMSEEW 系统工作原理示意图

核心思想

现有的早期地震预警(EEW)解决方案效果不佳:

- 地震仪由于对地面运动速度的敏感性而难以检测大地震;

- GPS 站容易产生大量嘈杂的数据,因此在检测中级地震方面无效。

作者介绍了分布式多传感器地震预警(DMSEEW)算法,该算法:

- 采用地震检波器和 GPS 站的传感器级预测(即正常活动、中等地震、大地震);

- 使用词袋表示汇总这些预测,并定义地震类别的最终预测。

此外,它们还引入了分布式网络基础设施,可以支持实时处理大量数据,并允许在灾难情况下将数据重定向到其他处理数据中心。

关键成就

实验表明,DMSEEW 算法在预测方面优于其他基线方法(即仅地震仪基线方法和采用相对强度规则的组合传感器基线方法):

对于大地震:

- 精度:76.7%和70.7%;

- 召回率:38.8%对34.1%;

- F1 得分:51.6%,而45.0%。

对于中地震:

- 精度:100%和63.2%;

- 召回率:100%与85.7%;

- F1 得分:100%和72.7%。

2

论文地址:https://arxiv.org/abs/2002.09309

论文

《通过高斯过程后验进行快速采样方法》

荣誉

获得 ICML 2020 荣誉奖

摘要

在本文中,作者探索了从高斯过程(GP)后验有效采样的技术。在研究了使用傅立叶特征的朴素方法进行采样和快速逼近策略的行为后,他们发现其中许多策略是互补的。因此,他们引入了一种方法,该方法结合了最好的不同采样方法。

首先,他们建议将后验分解为先验和更新的总和;然后,他们将此想法与有关近似 GP 的文献技术相结合,并获得了易于使用的通用方法进行快速后验采样。

实验表明,解耦的样本路径可以以更低的成本准确地表示 GP 的后验。

核心思想

引入的从 GP 后验采样函数的方法基于以下观察:

- 可以通过将高斯随机变量与显式校正项组合来隐式调节高斯随机变量;

- 作者将这种直觉转化为高斯过程,并建议将后验分解为先验和更新的总和;

- 在这种分解的基础上,研究人员提出了一种有效的快速后验采样方法,该方法可以与稀疏近似值无缝配对以在训练期间和测试时实现可伸缩性。

关键成就

本文介绍了一种易于使用的通用方法来从 GP 后验过程进行采样;

通过一系列实验演示如何解耦样本路径:

- 避免替代采样策略的许多缺点;

- 以更低的成本准确地代表 GP 后验。例如,使用解耦采样仅需 20 秒即可模拟一个众所周知的生物神经元模型,而迭代方法则需要 10 个小时。

3

论文地址:https://arxiv.org/abs/2001.09977

论文

《迈向拟人化的开放域聊天机器人》

摘要

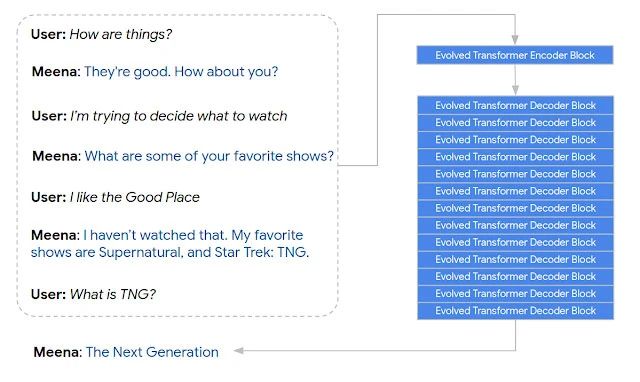

本文介绍了 Meena,一个多回合开放域聊天机器人,对从公共领域社交媒体对话中提取和过滤的数据进行了端到端的训练。

这是一个包含 26 亿个参数的端到端训练的神经对话模型。我们证明,与现有的最先进 (State-Of-The-Art) 聊天机器人相比,Meena 可以进行更合理和更具体的对话。

我们针对开放域聊天机器人提出一项新的人工评估指标,即合理度和具体度平均值 (Sensibleness and Specificity Average, SSA),可捕获人类对话中基本但重要的属性。值得注意的是,我们提出了一项适用于任何神经对话模型,而且与 SSA 高度相关的自动指标「困惑度 (Perplexity)」,该指标可捕捉类似于人类的多轮对话中的关键要素。

我们的实验表明,困惑度与 SSA 之间有很强的相关性。困惑度最佳的 Meena,在 SSA 上得分很高(多回合评估为 72%),这表明如果我们能够更好地优化困惑度,则 SSA 可能达到人类水平的 SSA,即 86%。此外,完整版的 Meena(具有过滤机制和调谐解码功能)的 SSA 得分为 79%,比我们评估的现有聊天机器人的绝对 SSA 得分高 23%。

Meena 对话示例

核心思想

尽管近年来取得了一些进展,但是开放域聊天机器人仍然存在明显的弱点:它们的响应通常没有意义,或者过于模糊或笼统。

为了解决这些问题,Google 研究团队引入了 Meena(一种具有 26 亿参数的生成式会话模型),该模型针对从公共社交媒体对话中提取的 400 亿个单词进行了训练:

Meena 基于带有演进式变压器(ET)的 seq2seq 模型构建,该模型包括 1 个 ET 编码器块和 13 个 ET 解码器块。

在多回合会话中训练模型,输入序列包括上下文的所有回合(最多 7 个),输出序列为响应。

为了评测诸如 Meena 之类的开放域聊天机器人的质量,研究人员引入了一种新的人类评估指标,称为敏感度和敏感度平均值(SSA),它可以测量聊天机器人的两个基本方面:

- 有道理

- 具体化

4

论文地址:https://arxiv.org/pdf/2005.14165v2.pdf

论文

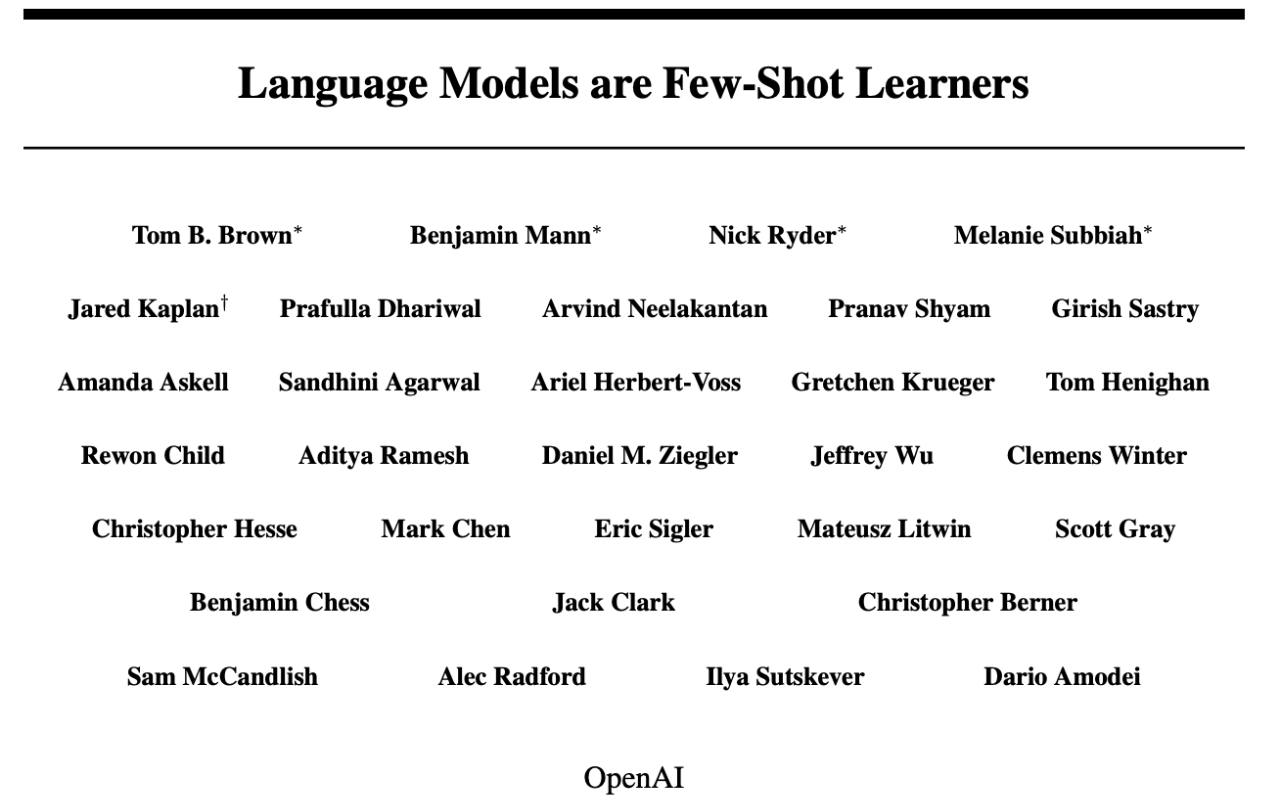

《语言模型是 Few-Shot 学习者》(OpenAI)

荣誉

获得 NeurIPS 2020 最佳论文。该论文介绍了 GPT-3 模型,在今年引起人工智能界,尤其是 NLP 领域的热议。GPT-3 的规模和语言能力是惊人的,它可以虚构、开发程序代码、编写深思熟虑的商业备忘录、总结文本等。虽然对其的质疑也一直存在,但它确实展示了 NLP 领域的巨大进步。

摘要

我们训练了 GPT-3(一种具备 1750 亿个参数的自回归语言模型,比之前的任何非稀疏语言模型多 10 倍),并在少许测试中测试了其性能。

对于所有的任务,应用 GPT-3 无需进行任何梯度更新或微调,而仅需要经过与模型的文本交互指定任务和少许演示便可。GPT-3 在许多 NLP 数据集上均具备出色的性能,包括翻译、问题解答和完形填空任务,以及一些须要即时推理或领域适应的任务。

核心思想

GPT-3 主要聚焦于更通用的 NLP 模型,解决当前 BERT 类模型的两个缺点:

- 对领域内有标签数据的过度依赖:虽然有了预训练 + 精调的两段式框架,但仍是少不了必定量的领域标注数据,不然很难取得不错的效果,而标注数据的成本又是很高的;

- 对于领域数据分布的过拟合:在精调阶段,由于领域数据有限,模型只能拟合训练数据分布,若是数据较少的话就可能形成过拟合,导致模型的泛化能力降低,更加没法应用到其余领域。

所以 GPT-3 的主要目标是,用更少的领域数据、且不通过精调步骤去解决问题。

5

论文地址:https://arxiv.org/abs/2005.04118

论文

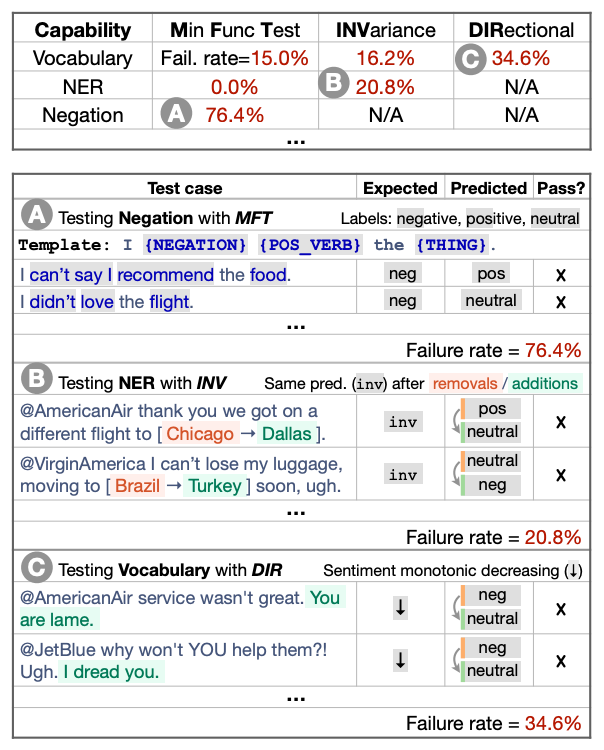

《超越准确度标准:NLP 模型的 CheckList 行为测试》

荣誉

ACL 2020 最佳论文奖

摘要

虽然度量支持精度是评价泛化的主要方法,但它往往高估了 NLP 模型的性能,而用于评估模型的替代方法要么侧重于单个任务,要么侧重于特定的行为。

受软件工程中行为测试原理的启发,我们介绍了一种用于测试 NLP 模型的不确定任务的方法。检查表包括一个通用语言能力和测试类型的矩阵,有助于全面的测试构思,以及快速生成一个包含大量不同测试用例的软件工具。

我们用三个任务的测试来说明检查表的效用,识别商业和最先进模型中的关键故障。在一项用户研究中,一个负责商业情绪分析模型的团队在一个经过广泛测试的模型中发现了新的、可操作的错误。在另一个用户研究中,使用 CheckList 的 NLP 实践者创建了两倍多的测试,发现的 bug 几乎是没有检查表的用户的三倍。

基于某商业情绪分析模型,进行模型否定能力的测试

核心思想

现有的 NLP 模型评估方法存在许多重大缺陷,比如可能性能高估、汇总统计数据对弄清 NLP 模型出了哪些问题以及如何修复这些错误没有太大帮助,以及缺乏全面性等。

为了解决此问题,研究团队引入了 CheckList,这是一种用于评估 NLP 模型的新方法,其受软件工程中的行为测试的启发:

- CheckList 为用户提供了要测试的语言功能列表,例如词汇,命名实体识别和否定;

- 然后,为了将潜在的能力故障分解为特定的行为,CheckList 建议使用不同的测试类型,例如在某些扰动情况下的预测不变性或定向期望测试。

- 潜在测试的结构为矩阵,功能为行,测试类型为列。

关键成就

使用 CheckList 对最新模型进行的评估表明,即使根据准确性结果认为某些 NLP 任务是「已解决」的,但行为测试还是强调了许多需要改进的地方。

将 CheckList 应用于经过广泛测试的面向公众的系统进行情感分析,结果表明该方法:

- 帮助识别和测试了以前未考虑的功能;

- 对先前考虑的功能进行更彻底和全面的测试;

- 帮助发现更多可操作的 bug。

限于篇幅,本期我们仅推送以上 5 篇,请大家先慢慢研读。下期我们将继续分享 2020 年值得关注的 AI 论文,敬请期待。

参考资料:

https://www.topbots.com/ai-machine-learning-research-papers-2020/#ai-paper-2020-1

内容提要:近日,多家机构发布了关于人工智能的年终回顾总结,从种种表现来看,疫情之下,AI 依然蓬勃发展,全球 AI 产业规模达到 1500 多亿美元。这背后,又有哪些突破性的研究值得关注?

关键词:AI 经典论文,NLP,CV

2020 年可谓魔幻的一年,我们见证了各种历史。不过令人欣慰的是,2020 年,人工智能领域的研究并没有停滞不前,反而是取得了十分耀眼的成绩。

今年的各大计算机顶会,取得了创纪录的论文提交量,以下几个数字更加直观:

6 月,CVPR 2020:共收到 6656 篇提交论文,比去年的 5165 篇增加了 28%;

7 月,ACL 2020:共收到 3088 篇提交论文,打破了该会议的 2906 篇的纪录;

7 月,ICML 2020:共收到 4990 篇提交论文,比去年的 3424 篇增加了 45.7%;

12 月,NeurIPS 2020:共收到 9467 篇论文,比去年的 6809 篇增加了 40%。

在这成千上万篇论文中,业内顶尖科技公司、专家学者一同精心挑选出 10 篇「必读论文」。

- 用于地震预警的分布式多传感器机器学习方法 A Distributed Multi-Sensor Machine Learning Approach to Earthquake Early Warning

- 通过高斯过程后验进行快速采样方法 Efficiently Sampling Functions from Gaussian Process Posteriors

- 迈向拟人化的开放域聊天机器人 Towards a Human-like Open-Domain Chatbot

- 语言模型是小样本学习者 Language Models are Few-Shot Learners

- 超越准确度标准:使用 CheckList 对 NLP 模型进行行为测试Beyond Accuracy: Behavioral Testing of NLP models with CheckList

- EfficientDet:可扩展和高效的目标检测EfficientDet: Scalable and Efficient Object Detection

- 对可能对称的、可变形的 3D 物体类别,进行无监督学习 Unsupervised Learning of Probably Symmetric Deformable 3D Objects from Images in the Wild

- 用于大规模图像识别的转换器 An Image is Worth 16×16 Words: Transformers for Image Recognition at Scale

- AdaBelief 优化器:根据观察梯度的 Blief 调整步长 AdaBelief Optimizer: Adapting Stepsizes by the Belief in Observed Gradients

- ALBERT:语言表示自监督学习的轻量 BERT ALBERT: A Lite BERT for Self-supervised Learning of Language Representations

在昨天《专家票选!2020 年度 10 篇人工智能经典论文(上)》中,我们已经介绍了前五篇,其余五篇请见下文。

6

论文地址:https://arxiv.org/abs/1911.09070v4

论文

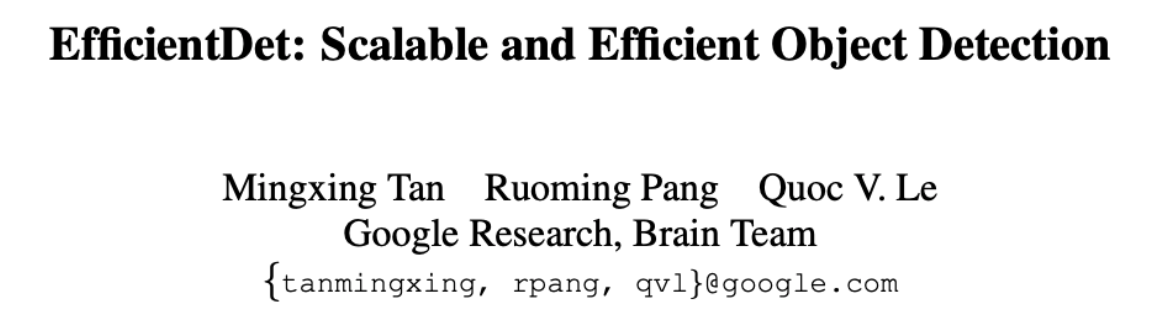

《EfficientDet:可扩展和高效的目标检测》

荣誉

为 CVPR 2020 所接收

摘要

模型效率在计算机视觉中越来越重要。在本文中,我们系统地研究了用于目标检测的各种神经网络体系结构的设计选择,并提出了提高效率的几个关键优化方案。

首先,我们提出了一种加权双向特征金字塔网络(BiFPN),它可以方便、快速地融合多尺度特征;其次,我们提出了一种混合缩放方法,可以同时对所有主干、特征网络和 box/class 预测网络的分辨率、深度和宽度进行均匀缩放。

基于这些优化,我们开发了一个新的对象检测器系列,称为 EfficientDet,在广泛的资源约束范围内,它始终能够达到比现有技术更好的数量级效率。特别是,在没有任何附加功能的情况下,我们的 EfficientDet-D7 在 COCO 数据集上实现了最先进的 51.0 mAP,参数为 52M, FLOPS1 为 326B,比之前最好的检测器小 4 倍,少用 9.3 倍的 FLOPS,但仍然比之前的检测器更精确(+0.3% mAP)。

核心思想

为了提高目标检测模型的效率,作者提出了:

- 加权双向特征金字塔网络(BiFPN),用于轻松快速地进行多尺度特征融合。它了解了不同输入特征的重要性,并反复应用了自上而下和自下而上的多尺度特征融合。

- 一种新的混合缩放方法,用于同时缩放所有主干,特征网络和框/类(box/class)预测网络的分辨率,深度和宽度。

这些优化与 EfficientNet 主干一起,可以开发一个新的目标检测器系列,即 EfficientDet。

关键成就

评估表明,EfficientDet 目标检测器,比以前最先进的检测器具有更高的精度,而参数却少得多,特别是:

- 参数为 52M 的 EfficientDet 模型,在 COCO 测试-开发数据集上获得了最新的 52.2 AP,超过了之前的最佳检测器(1.5 AP),但尺寸缩小了 4 倍,使用的 FLOP 减少了 13 倍;

- 通过简单的修改,EfficientDet 模型达到了 81.74% 的 mIOU 精度,在 Pascal VOC 2012 语义分割上,比 DeepLabV3 + 高出 1.7%,FLOP 减少了 9.8 倍;

- 与之前的检测器相比,EfficientDet 模型在 GPU / CPU 上的速度快 3 到 8 倍。

7

论文地址:https://arxiv.org/abs/1911.11130

论文

《对可能对称的、可变形的 3D 物体类别,进行无监督学习》

荣誉

获得 CVPR 2020 最佳论文奖

摘要

我们提出了一种基于原始单目图像中学习 3D 可变形物体类别的方法,且无需外部监督。该方法基于一个自动编码器,将每个输入图像分解为深度、反照度、视点和光照四个组件(将这四个组件结合起来即可重建输入图像)。

为了在没有监督的情况下解开这些成分,我们利用了至少在原则上,许多对象类别具有对称结构这一事实。当然,某些特定目标实例并不是完全对称的,无论在形状或者是外观上,我们也利用直接对光照进行建模,和对模型进行扩充的方法解决了该问题。

实验结果表明,该方法可以很准确地从单目图像中恢复人脸、猫脸和汽车的三维形状,无需任何监督和形状模型。在基准上,我们证明了,与另一种同类使用监督的方法相比,该方法在基准数据集上具有更优的性能。

基于单目图像对猫脸进行 3D 重建效果

对合成的 2D 小汽车单目图像进行 3D 重建效果

核心思想

本文所介绍的方法,目标是在两个挑战性条件下,从单个 RGB 图像重建可变形对象的 3D 姿态、形状、反照率和照明,这两个条件分别是:

- 无法获取 2D 或 3D ground truth 信息(真值),例如关键点,分割,深度图或 3D 模型的先验知识;

- 该算法必须使用无约束的单目图像集合,而没有同一实例的多个视图。

为了实现这一目标,研究人员提出:

- 利用对称性作为几何线索来约束分解;

- 明确建模光照,并使用它作为恢复形状的额外线索;

- 扩充模型,以推理物体中潜在的不对称。

关键成就

对该方法的定性评估表明,其可以高保真地重建人和猫的 3D 面孔,其中包含鼻子、眼睛和嘴巴的精细细节。

与其他最新的无监督方法相比,该方法可重构更高质量的形状,甚至优于 DepthNet 模型,后者使用 2D 关键点注释进行深度预测。

8

论文地址:https://arxiv.org/abs/2010.11929

论文

《用于大规模图像识别的转换器》

荣誉

投稿 ICLR 2021

摘要

虽然 Transformer 架构已经成为自然语言处理任务的事实上的标准,但它在计算机视觉上的应用仍然有限。在视觉上,注意力不是与卷积网络结合使用,就是在保持卷积网络整体结构不变的同时,代替卷积网络的某些部分。

我们证明了,对卷积神经网络(CNN)的这种依赖是不必要的,当直接应用于图像小块序列时,纯 Transformer 可以很好地执行图像分类任务。当在大量数据上进行预训练并转移到多个识别基准(ImageNet、CIFAR-100、VTAB 等)时,视觉转换器获得了与最先进的卷积网络相比的优秀结果,而训练所需的计算资源则大大减少。

核心思想

在将 Transformer 体系结构应用于图像时,作者尽可能地遵循为 NLP 设计的 Transformer 的原始设计。

- 引入的基于 Transformer 的图像分类方法包括以下步骤:

- 将输入图片拆分成 16×16 个 patches;

- 每个 patch 做一次线性变换降维同时嵌入位置信息;

- 将 patches 提供给标准的 Transformer 编码器;

- 在序列中添加一个额外的可学习的「class」标记位,并且以该位置的 Transformer Encoder 输出作为图像特征。

关键成就

在 JFT300M 数据集上进行预训练的 Vision Transformer,与基于 ResNet 的基线相匹配或优于后者,同时所需的计算资源也大大减少。它的精度为:

在 ImageNet 上:88.36%;

在 ImageNet-ReaL 上:90.77%;

CIFAR-100:94.55%;

牛津 IIIT 宠物数据集:97.56%;

牛津 102 花卉数据集:99.74%;

在 VTAB 套件(包含 19 个任务):77.16%。

9

论文地址:https://arxiv.org/pdf/2010.07468v1

论文

《AdaBelief 优化器:根据观察梯度的 Blief 调整步长》

荣誉

被 NeurIPS 2020 所接收

摘要

当下最流行的深度学习优化器(optimizer)可以广泛地分为自适应方法(如 Adam)和加速方案(如带动量的随机梯度下降(SGD))。对于许多模型,如卷积神经网络(CNNs),自适应方法通常比 SGD 收敛更快,但泛化较差;对于复杂的设置,如生成对抗网络(GANs),自适应方法通常是默认的,因为它们的稳定性。

我们提出了同时实现三个目标的 AdamBlief:能与自适应方法一样快速收敛,与 SGD 一样良好泛化,以及具有训练稳定性。

AdamBlief 的直觉是根据当前梯度方向上的「belief」来调整步长。将噪声梯度的指数移动平均(EMA)视为下一时刻梯度的预测,如果观测到的梯度与预测有很大偏差,我们就不相信当前的观测结果,并采取一小步;如果观测到的梯度接近于预测,我们就相信它,并采取一大步。

通过大量的实验验证了 AdamBlief 算法的有效性,表明该算法在图像分类和语言建模方面具有较快的收敛速度和较高的精度。

具体来说,在 ImageNet 上,AdaBelief 达到了与 SGD 相当的精度。此外,在 CIFAR10 上训练 GAN 时,与调试良好的 Adam 优化器相比,AdaBelief 表现出了高稳定性,并提高了生成样本的质量。

核心思想

AdaBelief 优化器的想法是将自适应优化方法(例如 Adam)和加速 SGD 优化器的优点结合起来。自适应方法通常收敛速度更快,而 SGD 优化器则具有更好的泛化性能。

AdaBelief 的 Blief 是根据我们在当前渐变方向上,可以信任的幅度来调整步长:

- 如果观测到的梯度与预测值有很大偏差,则我们对此观测值的信念不强,可以采取一些措施;

- 如果观测到的梯度接近于预测值,则我们对这一观测有强烈的信心,并会迈出一大步。

关键成就

AdaBelief Optimizer 具有三个关键属性:

- 快速收敛,如自适应优化方法;

- 良好的概括性,例如 SGD 系列;

- 在 GAN 等复杂环境中训练稳定性。

这些属性已通过广泛的实验验证,而且它在语言建模方面优于其他方法。

在 WGAN 的训练中,与 Adam 相比,AdaBelief 显着提高了生成图像的质量。

10

论文地址:https://arxiv.org/abs/1909.11942

论文

《ALBERT:语言表示自监督学习的轻量 BERT》

荣誉

拿下 13 项 NLP 任务,ALBERT 三大改造登顶 GLUE 基准。

摘要

预训练自然语言表征时,增加模型大小一般是可以提升模型在下游任务中的性能。但是这种纯粹依赖模型尺寸进而期望大力出奇迹的想法,在未来会越发困难。进一步增加模型大小将带来以下困难:

- GPU/TPU 内存不足;

- 训练时间会更长;

- 模型退化。

所以,为了解决上述问题,本文提出通过两种参数精简技术来降低内存消耗,并加快 BERT 的训练速度。此外,本文还引入一个自监督损失(self-supervised loss),用于对句子连贯性(inter-sentence coherence)建模,并证明该损失函数能够提升多句子作为输入的下游任务的性能。

本文所提出的模型 ALBERT 在 GLUE、RACE 和 SQuAD 这 3 个基准上都取得了新的 SOTA 结果,且参数量还少于 BERT-large。

核心思想

ALBERT 引入两种参数精简技术,克服了扩展预训练模型面临的主要障碍。

- 第一种是对嵌入参数进行因式分解;

- 第二种技术是跨层参数共享。

这两种技术都显著降低了 BERT 的参数量,同时不显著损害其性能, 从而提升了参数效率。

关键成就

ALBERT 在 GLUE、SQuAD 2.0、RACE 榜单上达到了 SOTA,并在多个方面推进了 NLP 研究。

以上就是所有今年值得一读的 AI 经典论文,字字精华,请细细研读。

原文:https://mp.weixin.qq.com/s/jSMpRVIxpvVcysEMMkBbag

既然来了,说些什么?