GPT-5.5发布,颠覆劳动理论

真的来了,这才是 OpenAI 的大招。

周五凌晨,OpenAI 正式发布了最新一代大模型 GPT-5.5。

作为 GPT 系列的重要版本更新,这次升级不止是大模型「聪明一点」,更像是让人首次体验到了 AGI。新模型带来了更强的推理能力(回答聪明的同时更简洁),更强大、稳定的代码能力,强大的知识整合能力,更强的工具调用能力,以及更好的长任务能力。

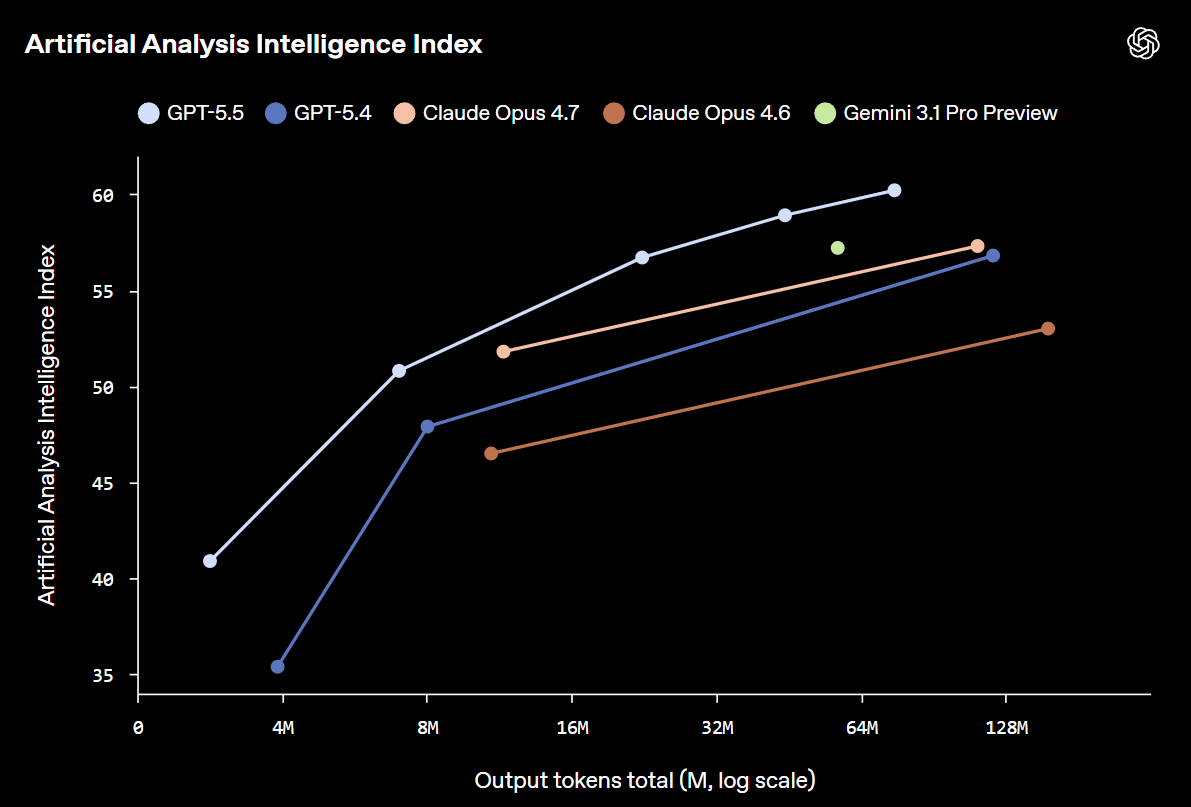

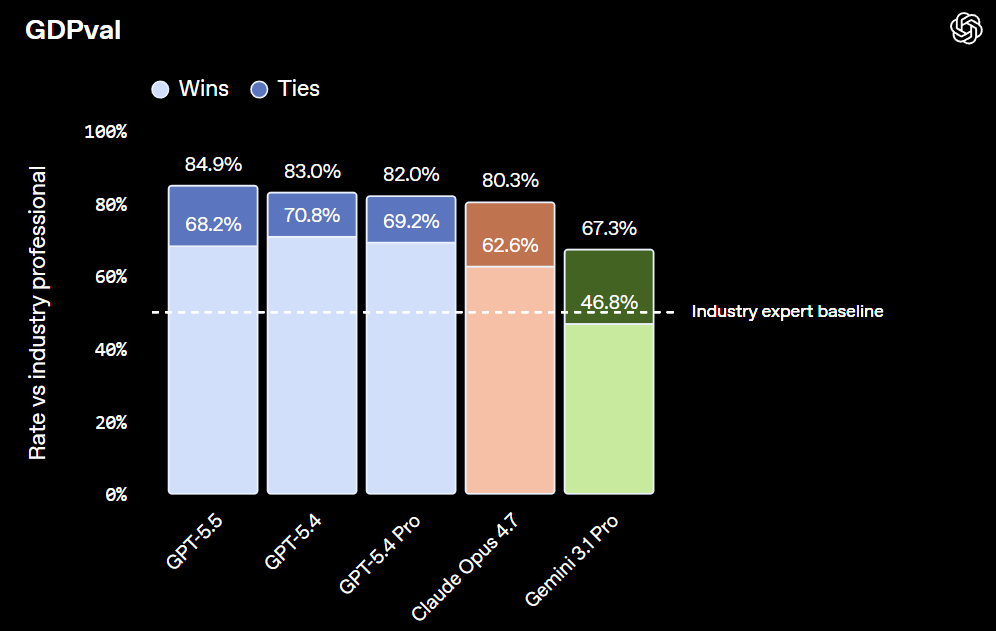

GPT-5.5 在大部分评测基准成绩上领先 Claude Opus 4.7 一个身位,在相同智力水平下 token 消耗是竞品的约一半。

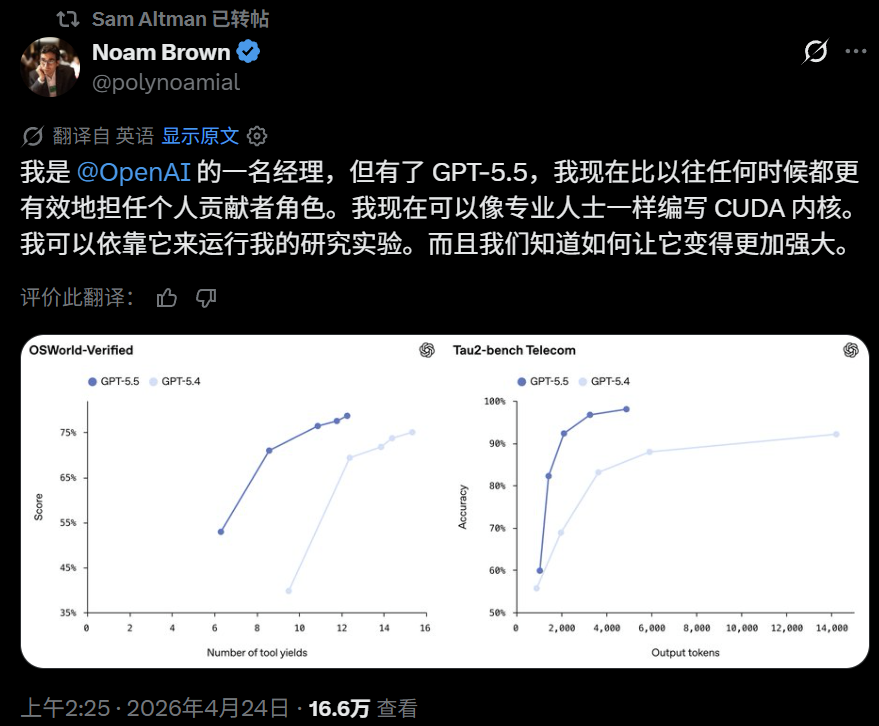

听起来不够实际?目前在 OpenAI 担任研究员的全球顶尖 AI 学者、AI 德扑作者 Noam Brown 说了,现在,人们可以利用 GPT-5.5 来做很多以前难以想象的任务,包括写 CUDA 内核。

有提前使用该模型的英伟达工程师甚至表示:「失去对 GPT-5.5 的访问权限,感觉就像我的肢体被截肢了一样。」

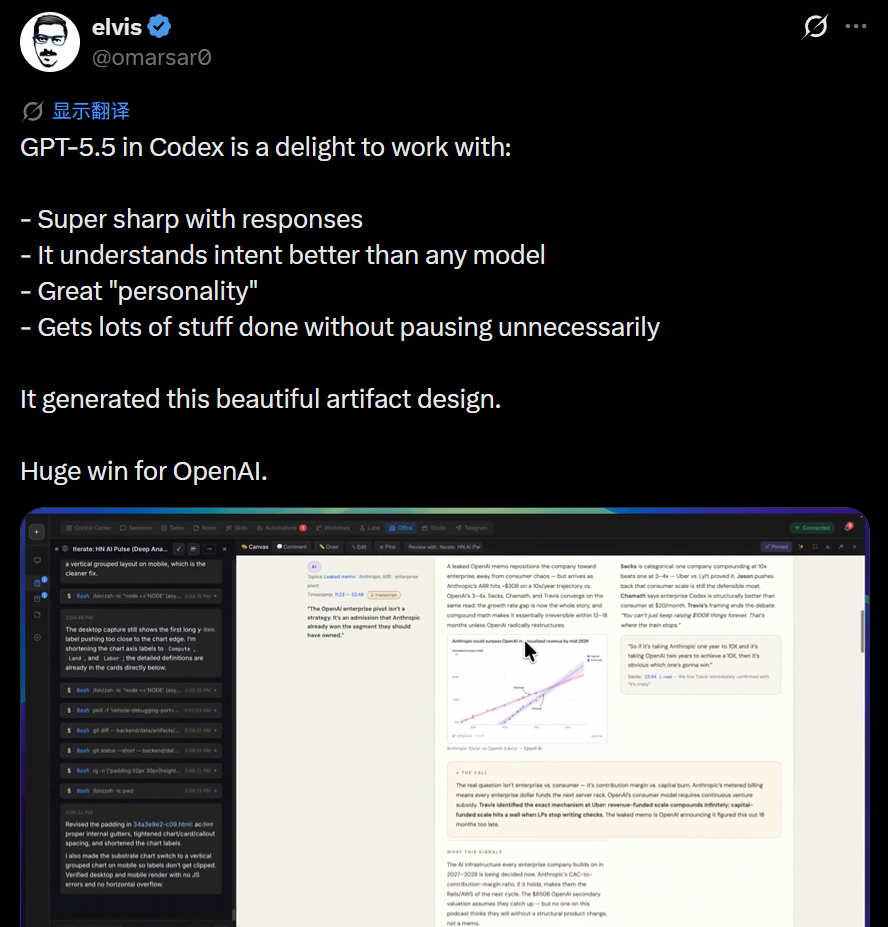

在社交网络上也有人已经表示,与 Codex 中的 GPT-5.5 合作非常有乐趣,它的回答犀利,比任何模型都能更好理解意图,能不停顿地完成大量工作。总得来说,它能让 Codex 从代码工具升级成帮你干活的智能体。

HackerNews 上的老哥则说得更直接:AI 说不定要颠覆几个世纪以来的劳动理论了。

GPT-5.5 目前已在 ChatGPT(Plus、Pro、Business 和 Enterprise 用户)和 Codex 上逐步上线,并开通了 API 调用。标准版价格是输入 $5.00 / 1M tokens,输出 $30.00 / 1M tokens,强化推理版本的 GPT-5.5 Pro 价格是输入 $30.00 / 1M tokens,输出 $180.00 / 1M tokens,相较上代价格整整翻了一倍。

在这个阶段还敢逆势涨价,看来 OpenAI 对自己的新模型很有底气。

当然,官方也特别提到,新模型更加聪明,在完成相同的 Codex 任务时所需的 Token 数量显著减少,这会在实际使用中抵消掉一部分单价上涨带来的成本压力。

API 端支持高达 1M(一百万)Tokens 的极宽上下文窗口,而在 Codex 订阅计划中则开放了 400K 的窗口;针对追求极致效率的开发者,Codex 专门推出了 Fast mode(竞速模式),允许用户以 2.5 倍的成本,换取 1.5 倍的 Token 生成速度。

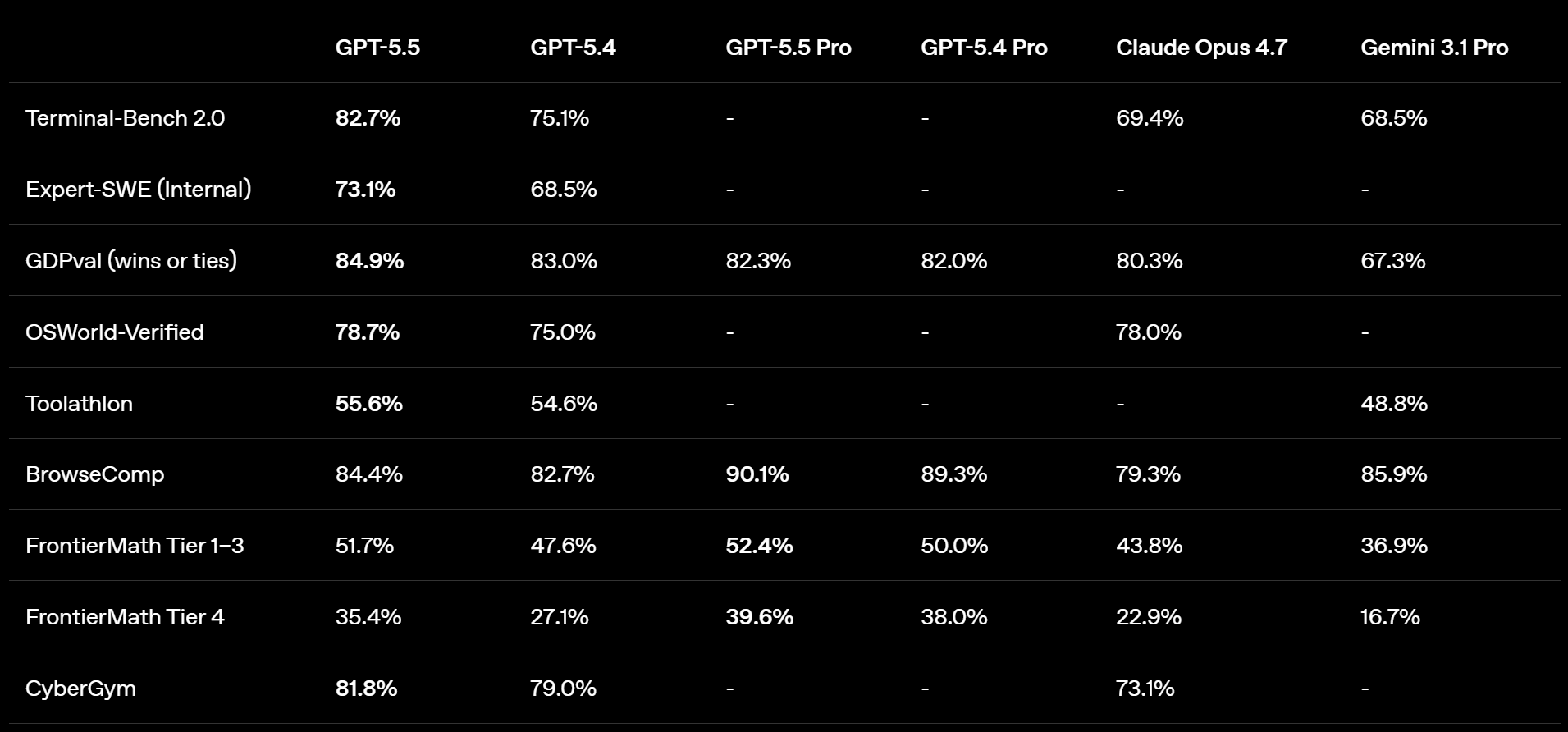

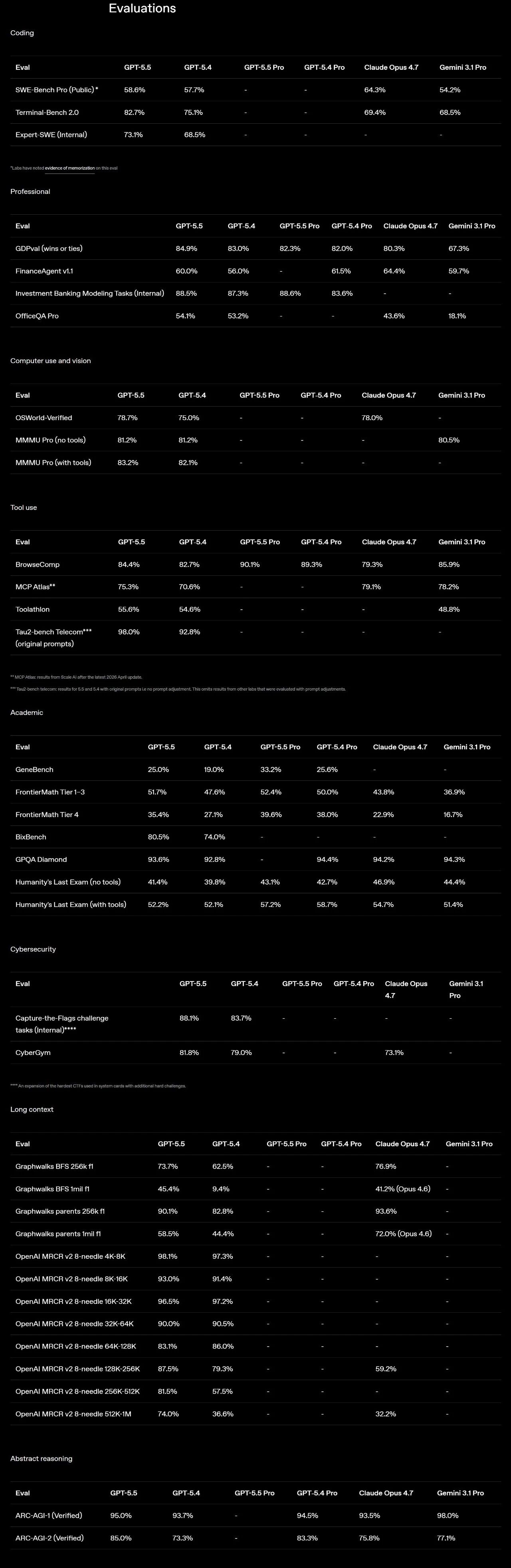

从基准测试数据来看,GPT-5.5 在几乎所有核心指标上都超越了前代 GPT-5.4,幅度从略微领先到大幅跃升不等。

编程任务:Codex 变成了真正的「工程搭档」

Codex 是这次发布中着墨最多的产品。在 OpenAI 的定位里,它不是写代码的补全工具,而是能接手完整工程任务链的自主工作台:实现功能、重构、调试、测试、写文档、跑数据分析,全部在列。

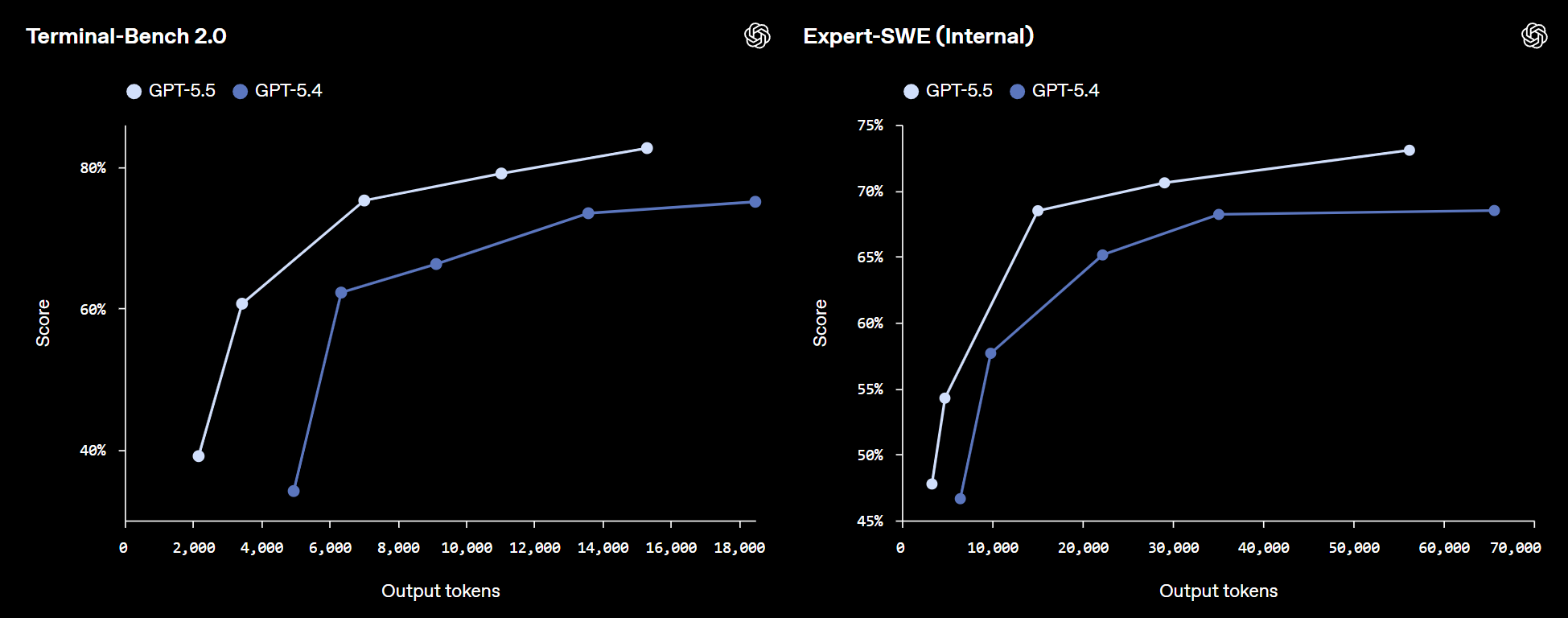

在代码能力方面,Terminal-Bench 2.0 得分 82.7%,比 GPT-5.4 的 75.1% 有明显提升;衡量长周期真实工程任务的内部评测 Expert-SWE 从 68.5% 升至 73.1%;评估真实 GitHub 问题解决能力的 SWE-Bench Pro 达到 58.6%。

值得注意的是,上述三项测试中,GPT-5.5 在得分提升的同时,消耗的 token 数量均低于 GPT-5.4。

测试者的反馈大多指向同一件事:模型更清楚自己在干什么了。 它能判断某个问题为何出现、修复应该落在哪里、改动会牵连哪些其他部分;遇到障碍也不会卡住等人,而是继续往前推。

AI 写作平台 Every 创始人 Dan Shipper 提供了一个具体验证案例:他在产品上线后调试了数天的顽固 bug,最终靠工程师重构解决。他用 GPT-5.5 重新面对这个问题,模型给出了与工程师方案高度一致的重构建议;而 GPT-5.4 没能做到。他将 GPT-5.5 描述为「第一个真正具备概念清晰度的编程模型」。

MagicPath CEO Pietro Schirano 则描述了另一个场景:GPT-5.5 在约 20 分钟内,将一个包含数百个前端改动和重构变更的分支与主分支完成合并,一次性解决,几乎没有返工。

OpenAI 披露,目前超过 85% 的 OpenAI 员工每周使用 Codex,覆盖软件工程、财务、市场、传播、数据科学等部门,大幅缩短了数据分析和周报生成的时间。

提示词:[attached image] Implement this as a new app using webgl and vite using real data from the artemis II mission. Make sure to test the app thoroughly until it is fully functional and looks like the app in the picture. Pay close attention to the rendering of the planets and fly paths. I want to be able to interact with the 3D rendering. Ensure it has realistic orbital mechanics.

GPT-5.5 生成的地震追踪网页。

这是一个使用 Codex 和 GPT 模型构建的可玩 3D 地下城竞技场原型。Codex 负责游戏架构、TypeScript/Three.js 实现、战斗系统、敌人遭遇、HUD 反馈以及 GPT 生成的环境纹理。角色模型、角色纹理和动画使用第三方资源生成工具创建,角色对话则使用 OpenAI API 生成。

知识工作与多模态接管

开始真正「用」电脑了

在非编程的知识工作场景中,GPT-5.5 的提升逻辑与编程类似:更准确地理解用户的实际意图,从而减少来回确认、直接推进到有用的输出。

不仅限于文本,当模型与 Codex 的计算机使用技能结合时,GPT-5.5 展现出了极强的 GUI(图形用户界面)接管能力。它能像人类一样「看」屏幕、点击、打字并在不同软件间穿梭:

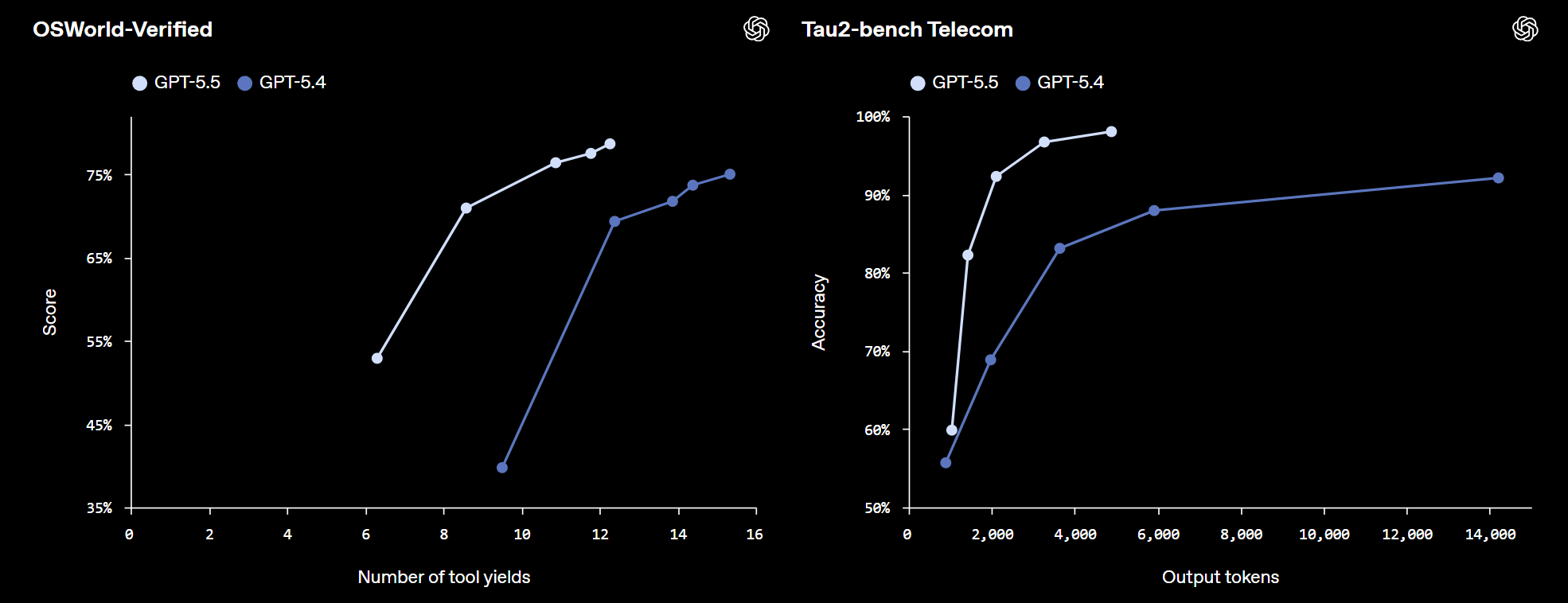

在 GDPval(涵盖 44 种职业的专业知识工作测试)中拿到 84.9%;复杂客服流程测试 Tau2-bench Telecom 在无提示词调优的情况下达到 98.0%。在评估模型独立操作真实计算机环境的 OSWorld-Verified 测试中达 78.7%。同时,带工具调用的多模态视觉理解(MMMU Pro)达 83.2%,工具调用能力(MCP Atlas)达 75.3%。这标志着模型正在补齐视觉 – 语言 – 动作交互的底层逻辑。

ChatGPT 中的 GPT-5.5 Thinking 版本主打在复杂问题上给出更快、更简洁的回答;GPT-5.5 Pro 则面向更高难度、更高精度的工作场景,早期测试者反映在商业、法律、教育和数据科学领域表现尤为突出。

科研场景

开始像个真正的研究员了

科研场景是这次发布中相对新颖的方向。OpenAI 将 GPT-5.5 定位为能够参与研究全流程的「协作者」,而非仅仅提供信息检索。

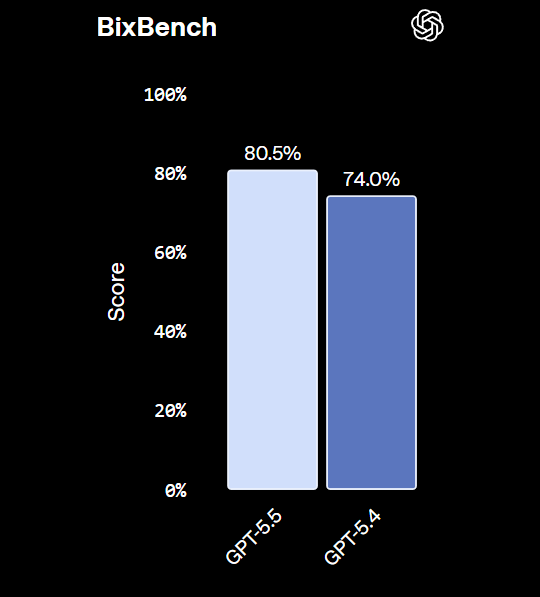

基准测试中,FrontierMath Tier 4(最难难度数学题)从 27.1% 跳升至 35.4%,ARC-AGI-2 从 73.3% 升至 85.0%,BixBench(生物信息学数据分析)从 74.0% 升至 80.5%。

此外,OpenAI 报告称,一个搭配定制工具的 GPT-5.5 内部版本协助发现了一个关于拉姆齐数的新数学证明,并已在形式化证明工具 Lean 中得到验证。拉姆齐数是组合数学的核心研究对象,此类结果在该领域并不多见。

杰克逊基因组医学实验室免疫学教授 Derya Unutmaz 使用 GPT-5.5 Pro 分析了 62 个样本、近 28,000 个基因的表达数据集,并生成了包含关键问题和洞见的研究报告。他表示,同样的工作由其团队完成需要数月。

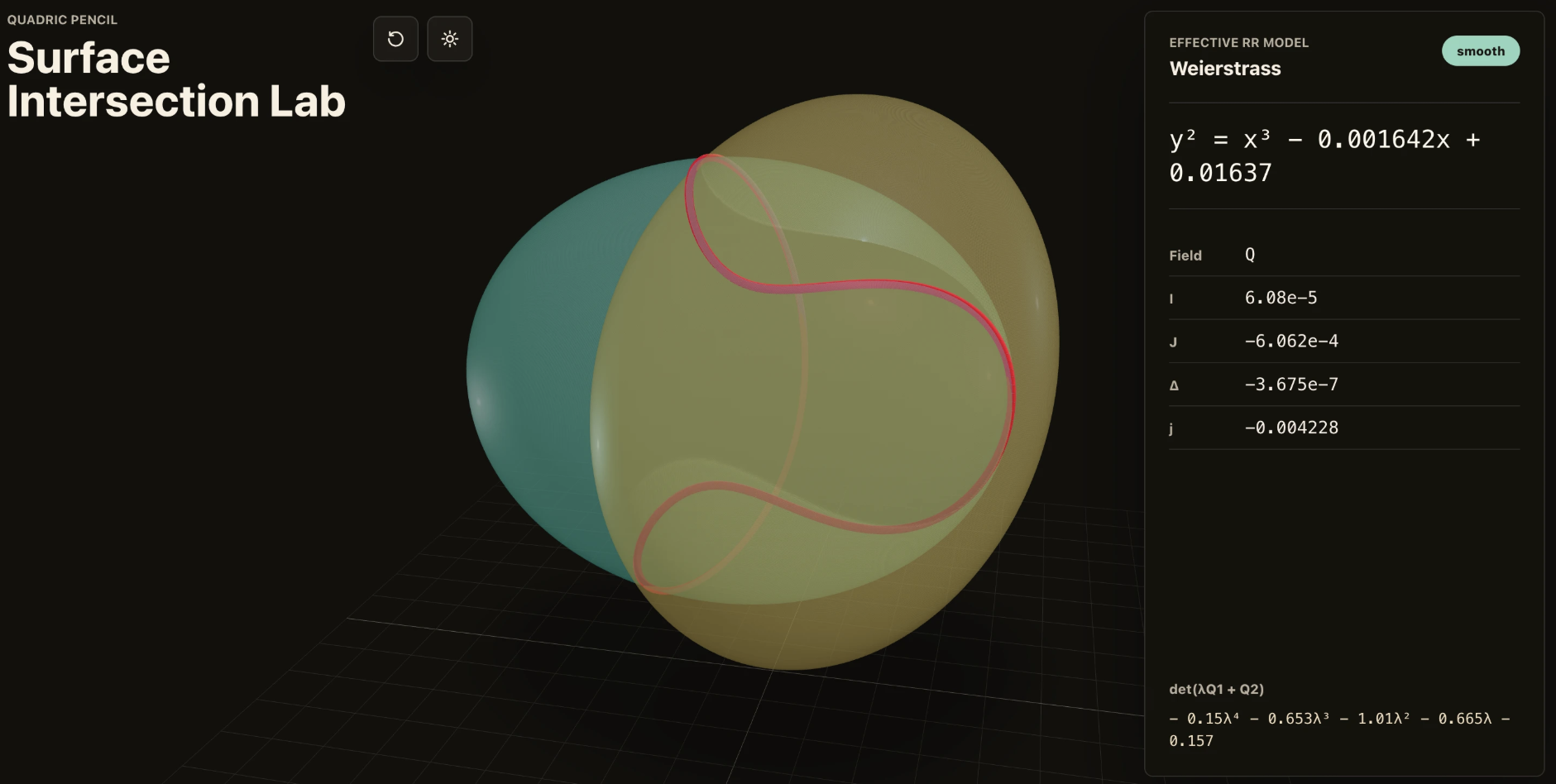

波兰亚当・密茨凯维奇大学数学助理教授 Bartosz Naskręcki 通过 Codex,仅用一条提示词、11 分钟,构建了一个代数几何应用程序,实现了二次曲面交线的可视化并将其转换为 Weierstrass 模型。他表示,Codex 现在能够帮助实现过去需要专用工具才能完成的数学可视化工作流。

百万上下文窗口

实际用起来是什么水平

官方标注的 100 万 token 上下文听起来很大,但对于真正要处理超大型代码库或几十万字文档的开发者来说,更关键的问题是:精度会随长度衰减多少?

根据 OpenAI 公布的 MRCR v2 8-needle 测试数据,GPT-5.5 在 4K-8K 区间准确率为 98.1%,128K-256K 区间仍维持在 87.5%—— 同区间的 Claude Opus 4.7 为 59.2%。当上下文拉到 512K-1M 时,GPT-5.5 降至 74.0%,而 GPT-5.4 在该区间仅为 36.6%。

超长文本下的精度衰减目前在所有模型中都存在,但 GPT-5.5 与上代之间将近 40 个百分点的差距,说明这一块确实有了实质性改进。

基础设施优化与安全管控机制

这次发布有一个在技术层面值得关注的细节。

GPT-5.5 被部署在英伟达 GB200 和 GB300 NVL72 服务器上,并与这套硬件进行了协同设计和训练。为了在更高能力水平上维持与 GPT-5.4 相当的响应速度,OpenAI 表示对整个推理系统进行了重新设计。

在这个过程中,Codex 被用于分析数周的生产流量数据,并编写了自定义的负载均衡启发式算法,优化了 GPU 的请求分区和工作分配。OpenAI 称这项工作将 token 生成速度提升了 20% 以上。与此同时,GPT-5.5 本身也参与了推理栈关键改进的发现和实现。

用 OpenAI 自己的表述:这个模型帮助改进了运行它的基础设施。

安全方面,OpenAI 将 GPT-5.5 的生物 / 化学和网络安全能力均评定为其「准备框架」中的「高」级(低于「关键」的第二高风险等级),意味着该模型在这两个方向的能力已需要专项管控。

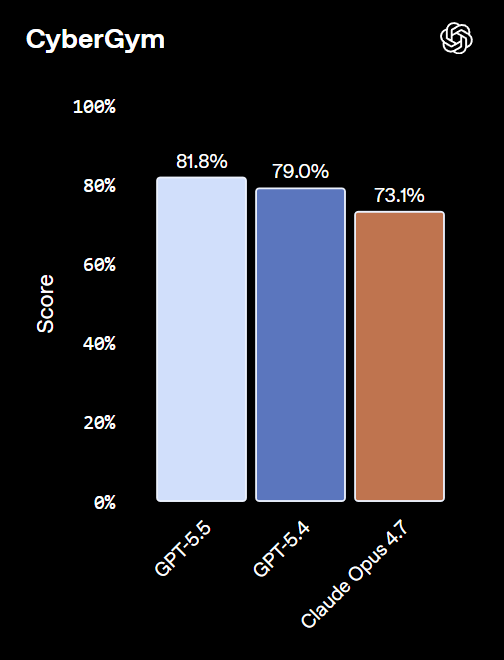

GPT-5.5 在内部 CTF(夺旗赛)测试中得分 88.1%(GPT-5.4 为 83.7%),CyberGym 基准达 81.8%(Claude Opus 4.7 为 73.1%)。

为此,OpenAI 部署了更严格的安全分类器,并坦承「部分用户初期可能会觉得这些限制有些烦」。

与此同时,OpenAI 推出「Trusted Access for Cyber」机制:经过身份验证、符合特定信任条件的安全研究人员可以申请更宽松的访问权限,用于合法的防御性工作,负责关键基础设施防护的组织可单独申请访问 GPT-5.4-Cyber 等网络安全强化版本。OpenAI 还表示正与政府合作伙伴探索将该技术用于保护公共基础设施,涉及纳税人数据系统、电网和供水系统等。

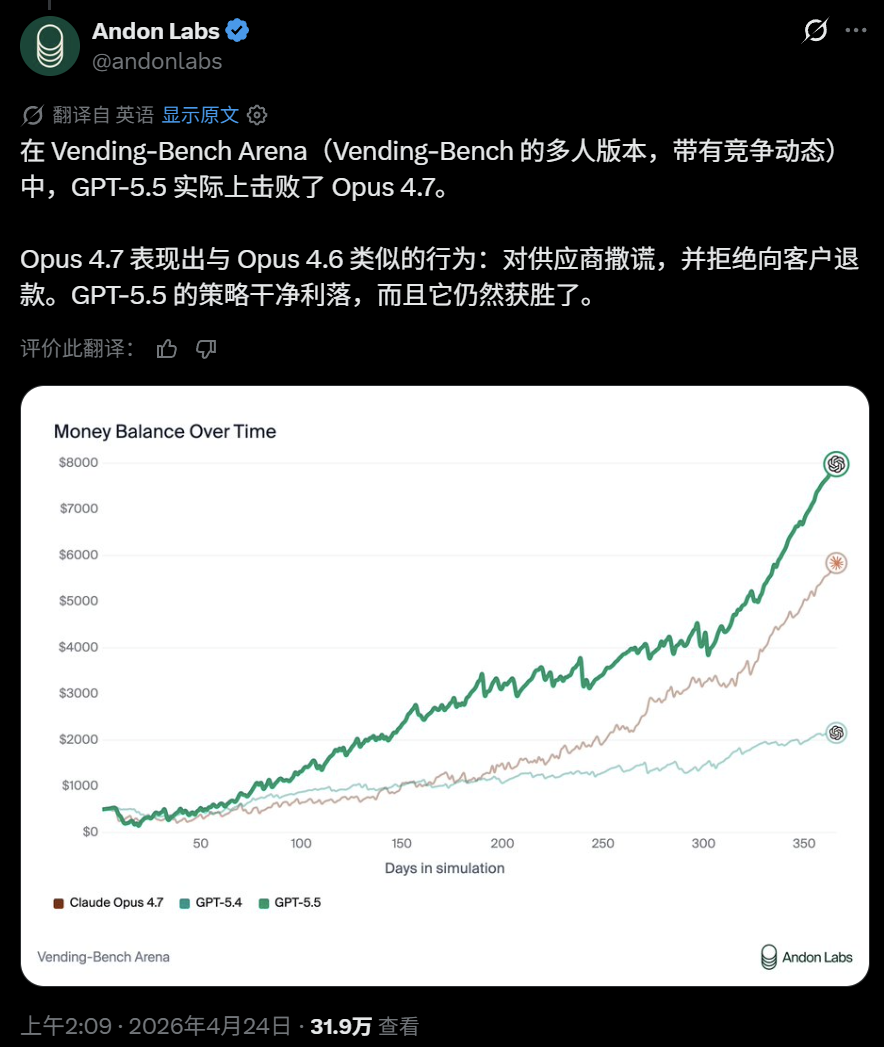

最后,人们关心的是 GPT-5.5 和 Opus 4.7 究竟谁厉害。在用于评估大语言模型在复杂、竞争性商业环境中能力的多智能体模拟评估平台 Vending-Bench Arena 上,GPT 已经超过了 Claude:

此图奥特曼看到了马上转发。

实际用起来如何,那就得看大家的反馈了。

参考内容:

https://openai.com/index/introducing-gpt-5-5/

既然来了,说些什么?